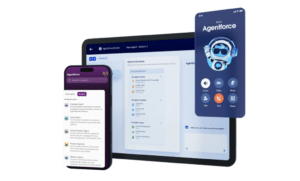

Salesforce continue à déployer beaucoup d’énergie pour embarquer les entreprises vers l’IA. Après avoir multiplié les initiatives marketings autour de Agentforce, son agent IA, l’éditeur américain de CRM tente de vulgariser les principes des agents IA dits intelligents. Objectif : lutter contre la réalité actuelle de l’IA et la déception engendrée par certains usages.

Les promesses de l’IA ne sont pas toujours tenues. Parfois cela est lié à une mauvaise pratique. Parfois c’est du au niveau de maturité technologique de l’IA. Selon une étude récente de Salesforce, 78 % des salariés cesseraient d’utiliser un agent IA s’il produisait des réponses incorrectes. Toujours selon les études de Salesforce les taux d’hallucinations des chatbots IA sur le marché varient de 3 % à 27 %. Des taux inacceptables dans bien des domaines notamment dans la relation client.

Pour augmenter la qualité des réponses des agents IA Saleforce recommande trois choses : utiliser les logiciels d’interrogation complexes de type LLM (Large Language Model), utiliser des données de qualité et unifiée (dans un accès cloud) et documenter les réponses à travers « des informations plus contextuelles et exploitables, notamment des citations en ligne qui indiquent les sources utilisées comme c’est le cas pour Agentforce pour élaborer sa réponse » préconise Salesforce. Cela implique de partager ses données métiers dans leur totalité. Un pas rarement franchi par les entreprises dans leurs projets IA.

Comment fonctionne sa nouvelle génération d’agents IA ?

En utilisant le raisonnement par inférence de type “système 2”, le moteur de raisonnement Atlas, explique Saleforce. Un système doté de raison qui peut extraire les données les plus pertinentes, puis raisonner et agir, améliorant ainsi la qualité des réponses. Le raisonnement de l’agent IA est enrichi par la méthode RAG* (Retrieval Augmented Generation) qui permet d’extraire les données et métadonnées définies comme pertinentes et dont le résultat est évalué par l’agent IA lui même. Un peu comme réfléchir avant de parler. Ce type de solution nécessitera toujours de travailler sur des données de qualité et des scénarios validés par l’intelligence humaine. Pour l’instant c’est toujours le raisonnement humain qui augmente, par l’automatisation et la puissance de calcul, le raisonnement intelligent de l’agent IA. Ce n’est pas l’inverse.