En publiant son projet de réglementation européenne en matière d’IA, l’Union européenne vise la louable protection des citoyens avec néanmoins le risque de freiner l’innovation technologique en Europe. Mais la future réglementation européenne pourrait aussi s’étendre à l’international car la demande d’une IA éthique et transparente se renforcera probablement.

Présentée le 21 avril dernier, la proposition de règlement de la Commission européenne pour encadrer les usages à risque de l’intelligence artificielle doit maintenant faire l’objet de discussions au Parlement européen et au niveau des Etats membres de l’Union européenne. La centaine de pages de ce projet avait été précédée d’un livre blanc publié en février 2020 qui annonçait déjà la teneur de la récente proposition de loi.

Ce cadre juridique visant la protection des droits fondamentaux et la sécurité des utilisateurs s’appliquera aux secteurs publics et privé à l’intérieur comme à l’extérieur de l’UE. Tout système d’IA mis sur le marché dans l’Union européenne ou dont l’utilisation aura une incidence sur des personnes situées dans l’UE sera également concerné. Ainsi un développeur comme Amazon avec AWS ou une entreprise utilisatrice d’un système tiers comme Netflix qui utilise AWS devront s’y conformer.

Une approche réglementaire définie par quatre risques

Pour réglementer l’IA, l’Union européenne a choisi de considérer les risques et les avantages des systèmes d’IA en fonction de leurs secteurs d’application. La stratégie de l’Union européenne s’appuie sur une approche fondée sur quatre typologies de risques : inacceptable, élevé, limité, minimal.

Risque inacceptable : les menaces évidentes pour la sécurité, les moyens de subsistance et les droits des personnes mais aussi les manipulations de comportement humain privant les utilisateurs de leur libre arbitre ainsi que la notation sociale des individus par les États.

Risque élevé : les technologies utilisées dans les infrastructures critiques, l’éducation ou la formation professionnelle, l’accès à l’emploi, le maintien de l’ordre, l’administration de la justice, les processus démocratiques… Ces systèmes d’IA devront être conformes à obligations strictes pour être mis sur le marché.

Risque limité : les systèmes d’IA auxquels s’appliquent des obligations spécifiques en matière de transparence. Ainsi les utilisateurs doivent savoir qu’ils interagissent avec une machine et, par exemple, les chatbots en plein développement dans la relation client seront soumis à des obligations de transparence minimale.

Risque minimal : la proposition de loi autorise l’utilisation libre d’applications telles que les jeux vidéo ou les filtres anti-spam reposant sur l’IA.

L’UE précurseur de la réglementation du numérique

« Qu’il soit question d’agriculture de précision, de diagnostics médicaux plus fiables ou de conduite autonome sécurisée, l’intelligence artificielle nous ouvrira de nouveaux mondes. Mais ces mondes ont aussi besoin de règles » avait déclaré en septembre Ursula von der Leyen, présidente de la Commission européenne.

Le 15 décembre dernier, la Commission européenne a présenté les projets de règlements Digital Services Act (DSA) et Digital Markets Act (DMA). L’objectif est de parvenir à leur adoption début 2022. Après la mise en place du RGPD, la Commission européenne poursuit donc sa dynamique de réglementation du numérique. La nouvelle réglementation sur l’IA ne pourrait être effective que dans quelques années.

Reste à voir maintenant si l’UE pourra imposer des normes mondiales. Que cela soit en termes de monopole des GAFA, de fake news et de censure, de nouvelles formes de concurrences, de manque de transparence, le numérique ne pourra pas se développer sans être encadré. Toutes les craintes suscitées par l’IA ne font que renforcer le besoin de clarté des citoyens et des consommateurs. Une réglementation est inévitable.

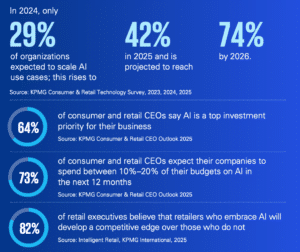

Des contraintes pour les entreprises européennes mais peut-être des opportunités

Pour les entreprises, l’enjeu sera maintenant d’intégrer ces contraintes dans leurs processus de développement d’IA. En cas de non-respect des règles, les entreprises pourraient être condamnées à une amende pouvant aller jusqu’à 6% de leur chiffre d’affaires. De plus, cette législation pourrait effrayer les entreprises voulant s’installer en Europe et fournir un avantage concurrentiel aux entreprises américaines, chinoises ou russes. Mais on imagine mal les grandes entreprises développant des programmes d’IA se passer du marché européen.

Mais comme démontré l’année dernière par une étude du cabinet OxFirst, l’Europe est très en retard sur les innovations en termes d’IA. Au cours des dix dernières années, la Chine a déposé 106 650 brevets d’IA, les États-Unis 60 003, la République de Corée 12 897, le Japon 9 882 et l’Europe 5 201. La future législation européenne risque de freiner le développement de l’IA en Europe mais pourrait pourquoi pas créer un marché européen spécifique basé sur l’éthique. Il est hélas probable que des scandales créés par l’IA surviendront et que, du coup, des associations de citoyens de démocraties occidentales demandent à ce que la législation européenne sur l’IA soit appliquée dans leur pays. Dans ce cas, peut-être une chance pour l’IA version UE.

En savoir plus sur l’IA avec le glossaire Digital CMO

Agent intelligent – Algorithme – Analyse prédictive – Analyse syntaxique – Arbre de décision – Assistants virtuels – Bots – Big data ou mégadonnées – Chatbot ou agent conversationnel – Cognitive computing ou informatique cognitive – Data crunching – Data Mining – Data scientist – Deep learning (réseau neuronal profond) – DeepMind (Google) – Facebook Artificial Intelligence Research (FAIR) – HAL 9000 – Internet des objets – Lab126 (Amazon) – Lois d’Asimov – Natural language processing (NLP) ou traitement automatique du langage naturel –Natural language understanding (NLU) ou compréhension du langage naturel – Machine learning – Marketing automation – OCR – OpenAI – Partnership on AI – Principes d’Asilomar – Réalité virtuelle et augmentée – RGPD – Réseaux de neurones – Robotique – Scénarii d’apprentissage – Supervised learning / unsupervised learning – Test de Turing– Watson